Moteur de recherche

- Jean-Michel Richer Université d'Angers

- JMR70

Site Web

EC Informatique - LERIA - Université d'Angers

11 Février 2026

Collège Saint-Charles, Angers

Moteur de recherche

Site Web

Google AI Studio : mauvaise IA (Terminator) vs bonne IA (Z-6PO/C-3PO)

Notre manière

d'utiliser l'IA

influencera notre avenir

une Intelligence Artificielle n'est rien d'autre qu'un programme informatique

ce programme s'exécute sur un ordinateur qui n'a aucune intelligence

alors comment ça marche ? pourquoi la machine nous apparaît-elle comme intelligente ?

un outil mécanique / électrique / électronique

calculatrice, micro-ordinateur, supercalculateur

En quelque sorte un orgue de Barbarie

les thinking machines

1956 Université d'été aux USA au Dartmouth College (New Hampshire)

Marvin Minsky, John McCarthy, Claude Shannon, Nathaniel Rochester, John Henry Holland, ...(lien Wikipedia)

Choix du terme IA

Définition de 1968

Science qui consiste à faire faire à des machines des choses qui exigeraient de l'intelligence si elles étaient faites par des hommes

Marvin Minsky (1927 - 2016)

A priori, calculer une moyenne n'est pas de l'IA

$ moyenne = \frac{10 + 14 + 12}{3}$

l'IA implique une part d'intelligence humaine :

créer des programmes qui incorporent de l'intelligence humaine

l'ordinateur est capable de traiter les problèmes par force brute : on teste toutes les solutions possibles

mais certains problèmes prendraient trop de temps à être traités en faisant tous les calculs nécessaires, il faut donc modifier ces programmes pour intégrer des astuces humaines

ce n'est que du calcul

trouver un chemin passant par tous les points d'un graphe complet une seule fois et de longueur minimale

Applications

Problème d'optimisation de complexité en $O(n!)$ si $n$ villes

la force brute n'est pas toujours adaptée

$117! \simeq 4 × 10^{192}$ soit $1,25 × 10^{176}$ ans pour résoudre le problème

on utilise des heuristiques (du grec ancien εὑρίσκω, heuriskô, «je trouve») qui sont des astuces

labyrinthe : se diriger en direction de la sortie

choisir la ville la plus proche : aller de proche en proche

mais ne donne pas forcément le meilleur chemin !

Autre exemple

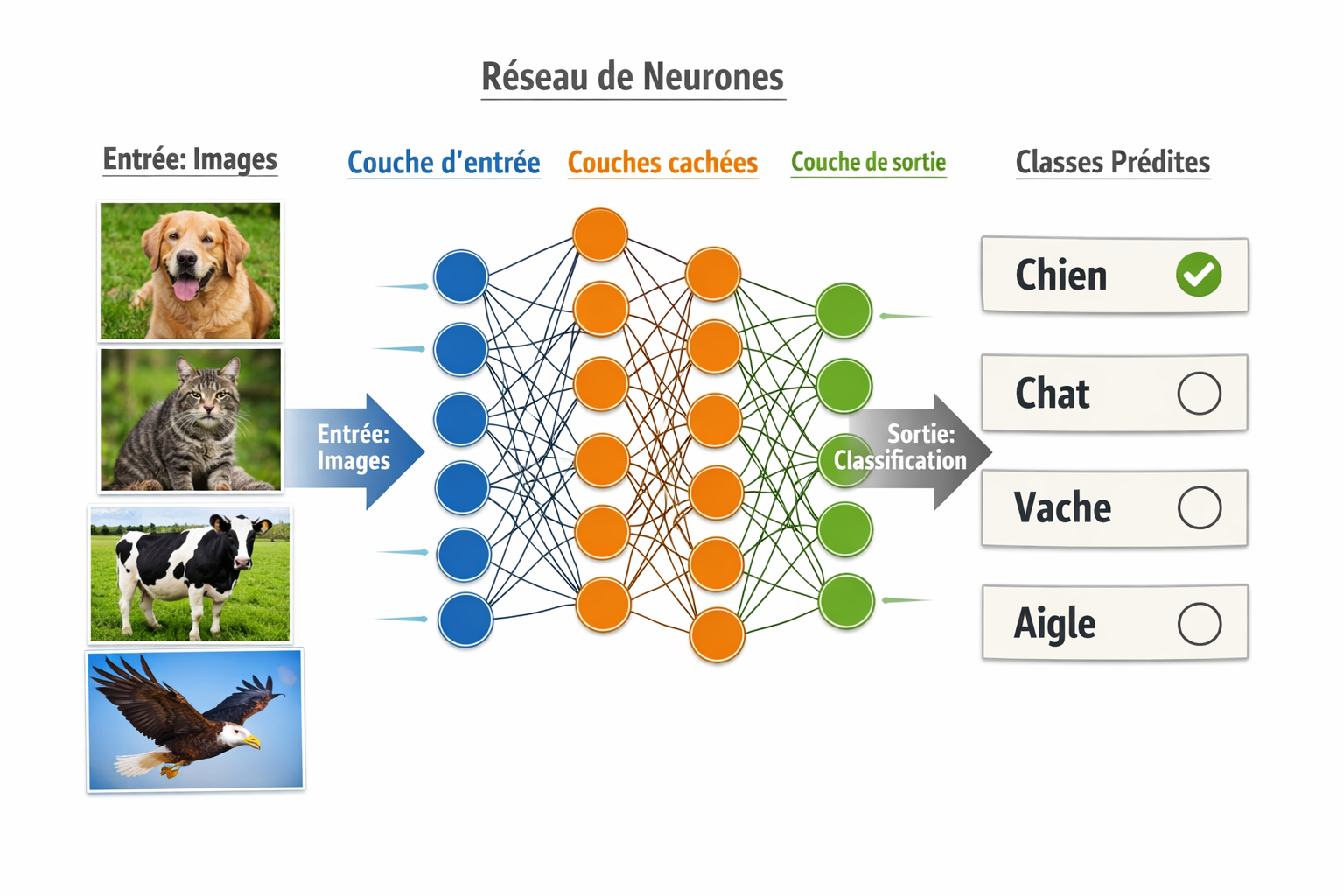

A la base des LLM (Large Language Models) et des IA génératives.

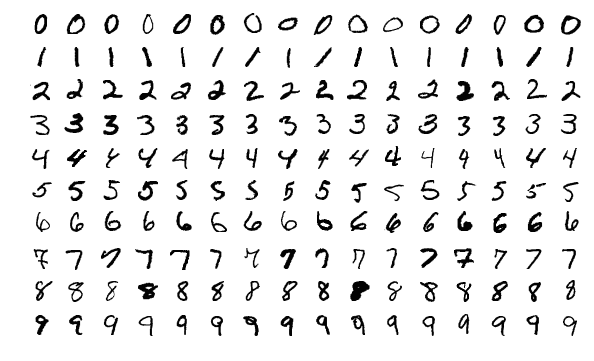

Exemple : reconnaissance de chiffres

MNIST (Mixed National Institute of Standards and Technology)

60000 images d'apprentissage et 10000 images de test en noir et blanc de 28 pixels de côté

un réseau de neurones est une fonction de calcul qui possède

le réseau «apprend» grâce aux exemples

un réseau de neurones permet de faire

il doit cependant «apprendre» avant de pouvoir inférer

une modélisation théorique d'un neurone :

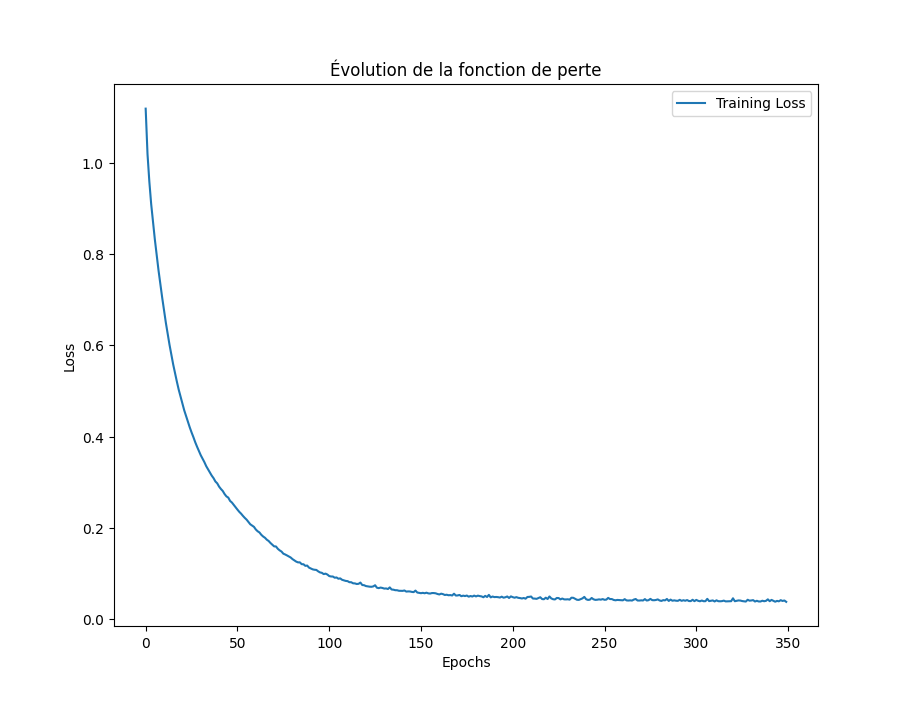

consiste à trouver les $w_{i,j}$, initialement aléatoires de manière à minimiser les erreurs sur les sorties

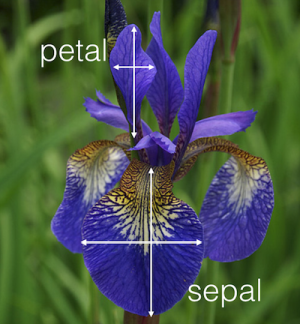

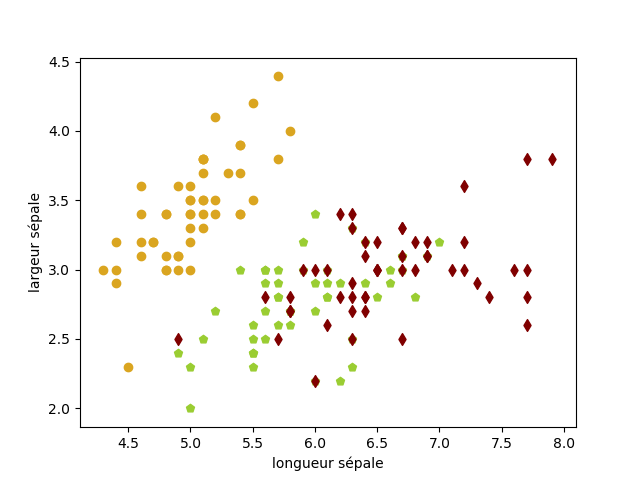

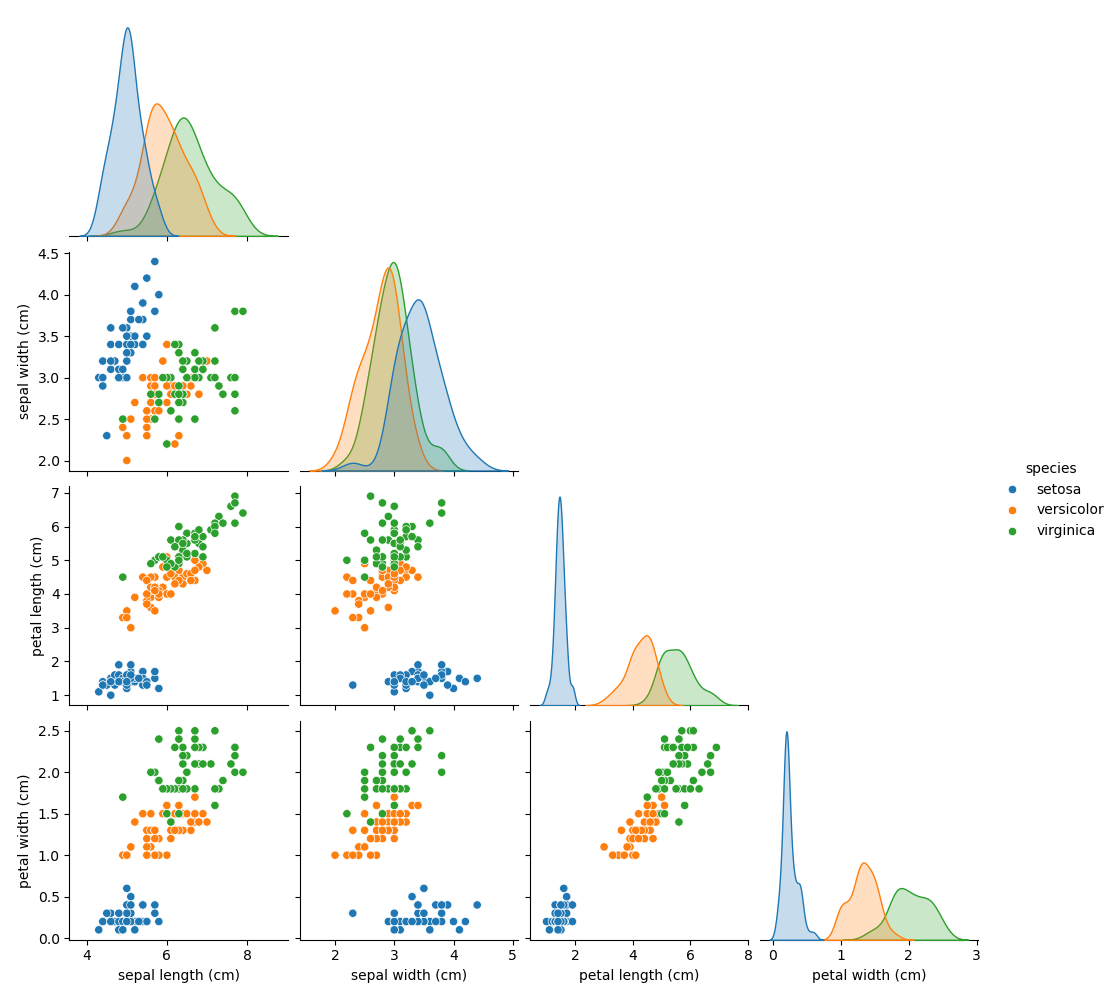

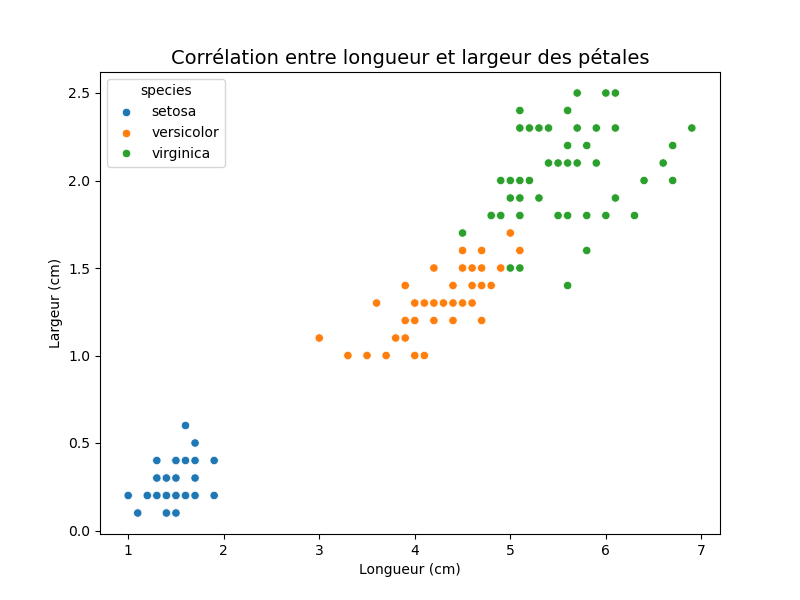

"sepal.length","sepal.width","petal.length","petal.width","variety"

5.1, 3.5, 1.4,. 2, "Setosa"

4.9, 3.0, 1.4, .2, "Setosa"

...longueur et largeur des sépales

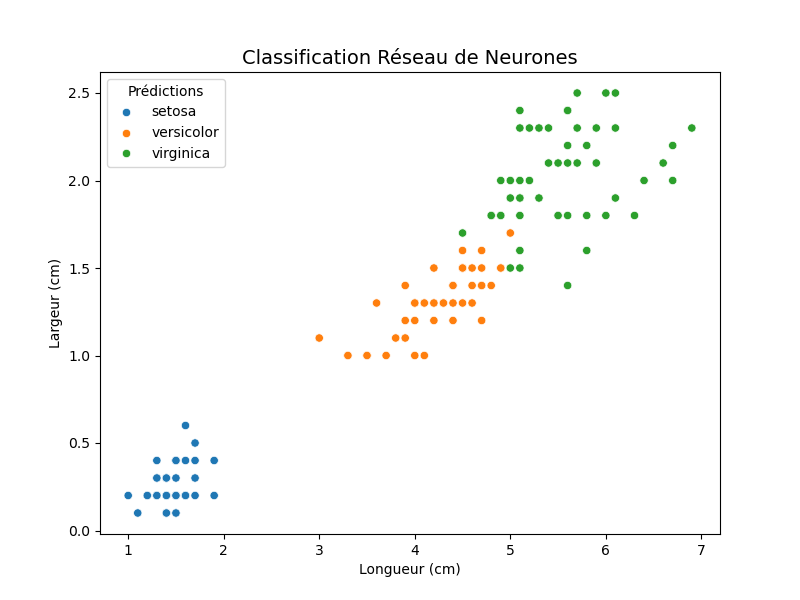

I0000 00:00 StreamExecutor device (0): NVIDIA GeForce RTX 3050,

Compute Capability 8.6

I0000 00:00 65852 cuda_dnn.cc:529] Loaded cuDNN version 90701

Temps d'exécution : 10.46 secondes pour 350 epochs

5/5 ━━━━━━━━━━━━━━━━━━━━ 1s 52ms/step

Accuracy NN: 0.99

Confusion Matrix NN:

s v v

e s i

t c r

set [[50 0 0]

vsc [ 0 49 1] ← mauvaise prédiction

vir [ 0 0 50]]

Classification Report NN:

precision recall f1-score support

setosa 1.00 1.00 1.00 50

versicolor 1.00 0.98 0.99 50

virginica 0.98 1.00 0.99 50

accuracy 0.99 150

macro avg 0.99 0.99 0.99 150

weighted avg 0.99 0.99 0.99 150

à la base des IA génératives il y a les LLM

Grands Modèles de Langage

Comment les LLM comprennent-ils ?

Transformer les mots en nombres : Word embeddings

Initialement :

deviner le contexte : "Le ___ mange la souris" $\rightarrow$ "chat".

Au final : un espace vectoriel sémantique

$V("roi") - V("homme") + V("femme") \simeq V("reine")$

apprentissage de la structure du langage

Gaston Lagaffe a découvert l'amérique à bord de la Santa Maria $\rightarrow$ en 1492

néanmoins l'ajout d'un pré-prompt permet de donner du sens à la conversation

Ceci est une conversation entre un élève et un professeur qui est là pour l'aider.

Elève : Je cherche à mieux comprendre le concept d'héritage en C++.

Professeur : $\rightarrow$ génération de la réponse

consiste à éduquer le modèle

Exemple : exécution d'une tâche directe

Utilisateur : "Résume en trois points clés l'importance des abeilles pour l'écosystème."

Assistant : 1. Pollinisation : Elles permettent la reproduction de 80 % des plantes à fleurs et de nombreuses cultures alimentaires. 2. Biodiversité : ...

Exemple multi-tours : conservation du contexte

Utilisateur : "Qui a écrit 'Les Misérables' ?"

Assistant : C'est Victor Hugo qui a écrit ce chef-d'œuvre de la littérature française, publié en 1862.

Utilisateur : "Donne-moi ses trois autres romans les plus connus." (Note : Le modèle comprend que "ses" se rapporte à Victor Hugo).

Bien sûr ! Voici trois autres œuvres majeures de Victor Hugo : Notre-Dame de Paris (1831)...

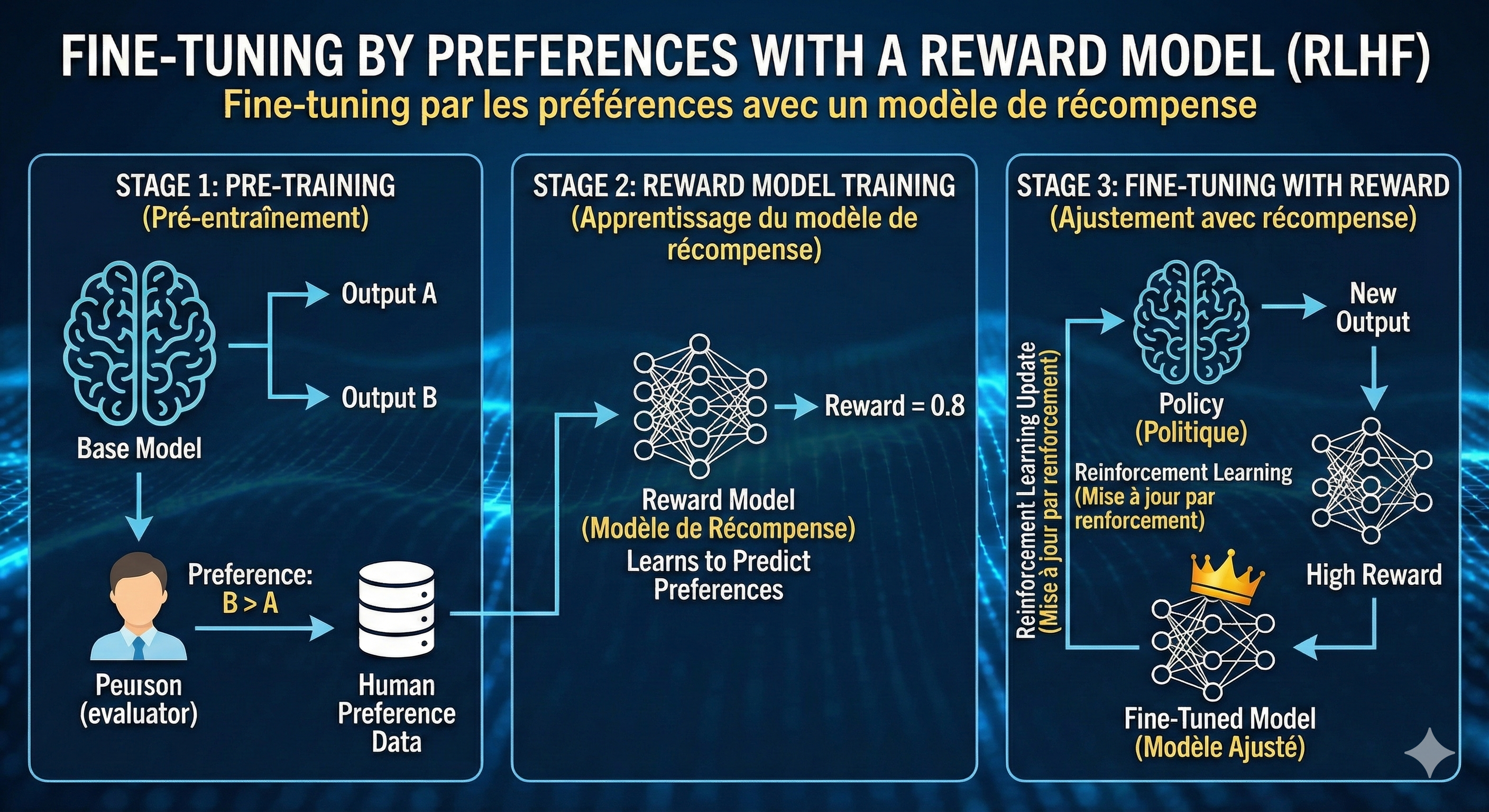

feedback sur les réponses produites

Variante avec modèle de récompense

un raisonnement apporte plus d'exactitude

constat : pour un humain, résoudre une équation complexe de tête est difficile, mais si on écrit chaque étape sur un papier, on réussit beaucoup mieux

Problème

Sarah a 5 pommes. Elle en donne 2 à son voisin. Elle achète ensuite 2 paquets de 3 pommes. Combien de pommes a-t-elle ?

sans CoT, le modèle peut se tromper

Sarah a 8 pommes

avec CoT

la «phrase magique» : Zero-Shot CoT

les chercheurs ont découvert en 2022 qu'il n'est même pas nécessaire de donner des exemples au modèle. Il suffit d'ajouter une simple phrase à la fin de sa question pour activer ce mode de pensée

réfléchissons étape par étape" (let's think step by step)

L'Attention : permet au modèle de pondérer l'importance de chaque mot par rapport aux autres

Le lion mange le zèbre, il est rassasié

il ? qui est rassasié ?

utilisation de sources de données externes spécialisées

MLLM - Multimodal Large Language Model

capacité à prendre en compte différentes sources de données

Exemples

L'IA = pas de magie, des calculs, simulation de la pensée

Cependant, L'IA commet des erreurs

L'IA ne pense pas, elle calcule. Mais elle calcule si bien qu'elle finit par produire les mêmes résultats qu'un être qui pense

Futurama